Creatività artificiali, con l’AI cervelli sintetici sono capaci di surrogare gli artisti

Una mattina dello scorso novembre, Hollie Mengert viene svegliata da una scarica di messaggi sul telefono. Con gli occhi ancora impastati dal sonno, l’illustratrice americana prende il cellulare e comincia a leggere. Al primo messaggio capisce che la situazione è seria. Al terzo che la sua carriera di disegnatrice per major come Disney e Nickelodeon è in pericolo. Al decimo sta già cercando il numero di un avvocato specializzato in diritto d’autore. I messaggi la indirizzano tutti a un post su Reddit di un tale che si fa chiamare MysteryInc152: “Visto che su Stable Diffusion gli stili d’illustrazione 2D scarseggiano”, scrive, “tramite DreamBooth ho creato un modello ispirato al lavoro di Hollie Mengert”. In pratica, grazie a una trentina d’illustrazioni originali firmate da Mengert, MysteryInc152 – in realtà uno studente d’ingegneria dell’Università di New Brunswick in Canada – ha messo a punto un modello di AI generativa in grado di creare i disegni più svariati con uno stile del tutto simile al suo, partendo da una descrizione testuale tipo: “Strega che vola su scopa in cielo tempestoso”. Poi ha pubblicato il modello, chiamato “holliemengert”, così che fosse utilizzabile da chiunque. «Mi sono sentita ingannata e defraudata», ha dichiarato Mengert in un’intervista al sito di tecnologia waxy.org, «pensavo a tutti gli anni serviti a sviluppare il mio stile. Ora chiunque può copiarmi grazie a una macchina che si è esercitata sul mio lavoro senza neanche chiedere il permesso». La questione è esplosa nel corso dell’ultimo anno, da quando le applicazioni di una nuova generazione d’intelligenza artificiale hanno debuttato presso il grande pubblico. Si chiama generative AI ed è capace di creare immagini, video, testi, musica e codici. In pratica, è un sistema che elabora informazioni per produrre contenuti “creativi”.

La rivoluzione della AI generativa

Supponiamo di avere una banca dati contenente 10 000 foto di scimmie. Dopo essersi addestrato su queste immagini, un modello di AI tradizionale può riconoscere la presenza di un primate in foto. Uno di AI generativa, invece, è in grado di creare immagini di scimmie diverse da quelle contenute nella banca dati, magari modellando le caratteristiche in modo casuale o in base alle richieste dell’utente. Negli ultimi anni, lo sviluppo di questa AI ha avuto un’accelerazione grazie a una crescente disponibilità di dati e ai progressi degli algoritmi di apprendimento automatico. Dietro questa rivoluzione ci sono giganti hi-tech come Google, Meta, Amazon e Microsoft, ma anche start-up che potrebbero diventare presto non meno famose come Stability AI, già considerata un unicorno per aver di recente superato il mld di € di capitalizzazione. I software protagonisti di questa rivoluzione sono decine. Fra i più conosciuti: Dall-E 2, Midjourney e Stable Diffusion per le immagini; Make-a-video e Imagen per i video; ChatGpt e Bard per la scrittura, codici inclusi; Amper Music, Aiva e Boomy per la musica. Sono strumenti incredibilmente potenti e relativamente facili da usare. Ma le questioni legali che si portano dietro sono irrisolte. Perché la verità sul diritto d’autore applicato all’AI è che nessuno sa esattamente cosa accadrà: «Al momento si va avanti per principio analogico perché manca una regolamentazione specifica», sottolinea Lucia Maggi, avvocato specializzato in copyright informatico dello studio milanese 42 Law Firm. «Il sistema non prevede che una macchina possa essere intestataria di alcun diritto. Quindi, generalmente, si presume che la proprietà dell’opera d’ingegno ricada sull’autore del codice».

Un esemplare dalla serie I Girasoli di V. van Gogh, Francesco Muzzi a “due mani” con midjourney.

La gioconda di Leonardo, Francesco Muzzi a “due mani” con midjourney.

Palestre per “non umani”

Ovviamente, le società titolari delle piattaforme di AI sposano questa interpretazione e s’intestano i diritti di immagini, musiche, testi. Anche all’utente che genera il contenuto, concedono la possibilità di usufruirne soltanto sotto condizioni definite dall’abbonamento sottoscritto. La logica è: meno si paga (in alcuni casi i servizi sono gratuiti), meno diritti si hanno. «Ma le cose si complicano se si prende in considerazione il concetto di opera su commissione», fa notare Maggi. Che aggiunge: «Questo prevede che l’opera sia di chi l’ha commissionata, non di chi la realizza». È lo stesso principio per cui, per esempio, un artista come Jeff Koons può vantare la paternità delle coloratissime sculture che vende in tutto il mondo. Pur ammettendo apertamente di non aver mai messo mano alla loro realizzazione, Koons può apporre la sua firma e incassare assegni stratosferici, pagando briciole agli operai iperspecializzati che le hanno modellate, colorate e saldate. «Più dettagliate sono le istruzioni del committente all’esecutore, più il diritto di proprietà si sposta da chi le realizza fisicamente a chi ha avuto l’idea.», fa notare Maggi, «In molti casi, il livello di input umano è la chiave per stabilire a chi spetta la proprietà». L’AI generativa, però, rende sempre più semplice istruire le macchine. È difficile tracciare i confini della paternità. Per fare un test, Maggi ha chiesto a due amici artisti di creare delle immagini con Midjourney. «Siamo partiti dalla stessa descrizione testuale. Poi ognuno ha preso la sua strada. Io non so disegnare e non è un caso che il mio risultato finale fosse inguardabile rispetto ai loro. Nonostante l’aiuto del software, evidentemente non ho la fantasia e la sensibilità necessarie per creare un’opera interessante». A settembre 2022, l’autorità americana sul diritto d’autore (Usco) ha concesso la prima registrazione di un graphic novel creato con Midjourney: 18 tavole illustrate con personaggi e dialoghi. A fine ottobre, la decisione è stata contestata e al momento è in fase di revisione. Fattore determinante sarà proprio la valutazione del reale contributo umano all’opera. L’autrice del fumetto, Kristina Kashtanova, ha dichiarato a IpWatchdog che Usco le ha chiesto di “dimostrare che c’è stato un sostanziale coinvolgimento nel processo di creazione”. Nonostante l’incertezza, il settore dell’AI generativa corre. Secondo la società di consulenza PitchBook, l’anno scorso sono stati pompati più di 1,3 mld di € nello sviluppo di questi cervelli al silicio, l’equivalente di quanto era stato investito nei cinque anni precedenti messi insieme. Le reti neurali alla base dell’AI necessitano di enormi quantità di dati per essere addestrate. Fino a non molto tempo fa, queste palestre virtuali erano sistemi chiusi, alimentate dal lavoro di “mechanical turks”, operai digitali pagati per allenare le macchine. Gente che passava ore davanti agli schermi a riconoscere immagini o a trascrivere file audio per insegnare ai computer a riconoscere un albero o a decifrare il suono di una parola. La svolta è avvenuta quando queste banche dati si sono aperte al contributo di utenti esterni, crescendo in modo esponenziale: «Oggi esistono piattaforme aperte dove chiunque contribuisce facendo da sparring partner ai cervelli sintetici in modo più o meno consapevole», spiega Arturo Tedeschi, designer computazionale che lavora al confine fra AI, arte e algoritmi. Che prosegue: «Quantità incredibili di informazioni sono ricavate dall’utilizzo di applicazioni, per esempio quando selezioniamo un link piuttosto che un altro, o addirittura leggendo le reazioni del viso grazie alle telecamere dei cellulari». Per ampliare le banche dati, aziende come l’inglese Stability AI, del software Stable Diffusion, hanno intuito fosse ora di cambiare il modello di fruizione. Mentre rivali come Imagen di Google riservano l’uso delle loro piattaforme a una cerchia ristretta e altri, come Dall-E di OpenAI, lo limitano creando liste d’attesa per accedere e filtri per impedire la creazione di alcuni tipi di immagini (per esempio violente o pornografiche), Stability AI ha aperto le gabbie: dall’agosto scorso permette a chiunque di usare il suo Stable Diffusion in modalità open source per generare qualsiasi tipo di immagine, raggiungendo una media di dieci mln di utenti al giorno. In poco tempo, questo ha ulteriormente arricchito la già sterminata palestra con cui il software s’allena, Laion, formata da oltre cinque mld di immagini.

“Creativi di tutto il mondo unitevi!

Un gruppo di creativi italiani, a partire dal visual artist Lorenzo Ceccotti non è d’accordo. E pubblica un Manifesto che ha raccolto l’adesione di migliaia di colleghi per chiedere all’Unione europea di regolamentare la AI così da rispettare il diritto d’autore e la privacy. Tra le richieste, il consenso obbligatorio da parte di autori e utenti all’inclusione nei dataset dei loro dati.”

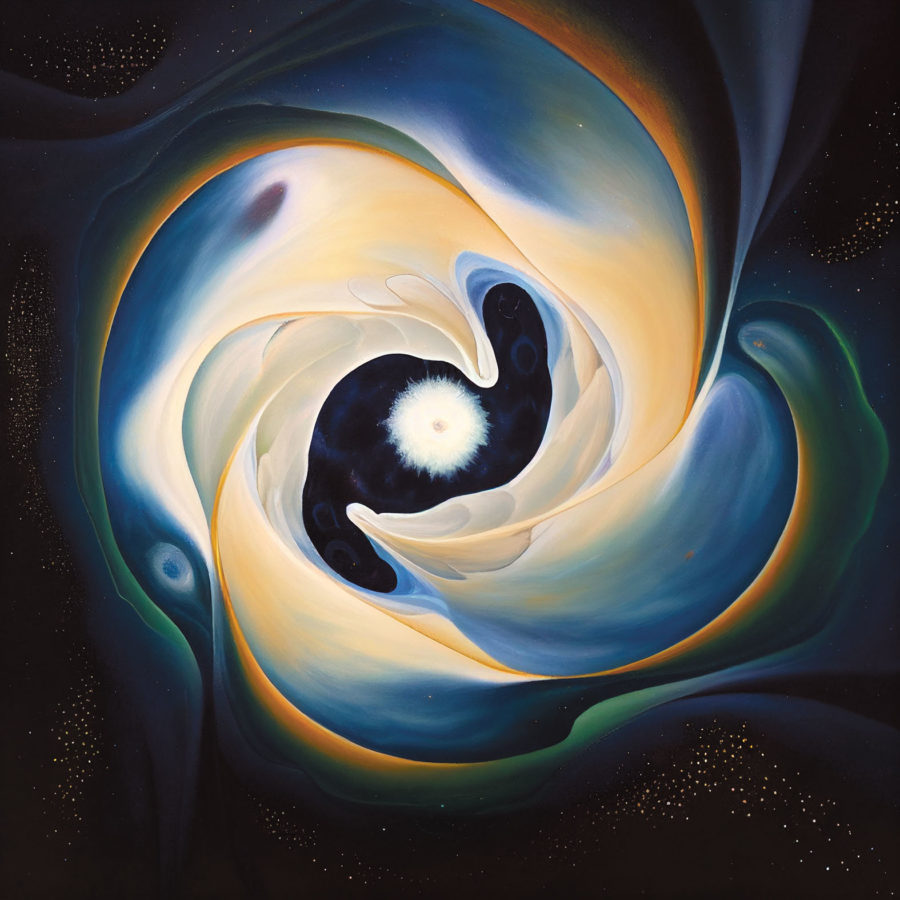

“Atomo” botticelliano, Francesco Muzzi e Midjourney.

L’allarme dei creativi

Ma la crescita smisurata delle banche dati (dataset) apre un altro grande interrogativo su cui giudici e avvocati stanno affilando le armi. Una questione che riguarda direttamente artisti come l’illustratrice americana Hollie Mengert. Tutti ci nutriamo a vicenda, studiando le idee e il lavoro degli altri per ispirarci o copiare. Da un certo punto di vista, si potrebbe dire che questo è quello che fa anche un algoritmo di AI generativa: apprende dal lavoro altrui. Solo che questo riesce a farlo in modo infinitamente più accurato e veloce rispetto a noi umani. Da qui il dubbio: fino a che punto è giusto permettere a un software d’imparare da modelli che persone reali hanno impiegato magari anni ad affinare senza neanche chiedere il permesso? Laion – utilizzata da Stable Diffusion, DeviantArt e Midjourney – contiene migliaia di immagini protette da copyright prese da internet. Se avete pubblicato foto o disegni online, esiste una buona probabilità che possano essere finiti in pasto a questi algoritmi senza che voi lo sappiate. Un collettivo di artisti, Spawning, ha creato un sito per controllare: haveibeentrained.com. La riprova di quanto le aziende hi-tech siano consapevoli di camminare su un terreno minato, sta nel fatto che alcune di esse si sono premurate di schermarsi, usando il paravento della ricerca. Il dataset di Laion fa capo a un’organizzazione no profit ed è stato sviluppato dal Computer Vision Lab dell’Università Ludwig Maximilian di Monaco. La legislazione europea permette l’uso di materiale coperto da copyright per ricerca e sperimentazione, a meno che non sia stato espressamente proibito. «Ma l’onere è in capo all’autore», sottolinea Giorgio Franceschelli, esperto di Deep Learning e dottorando all’Università di Bologna, «E molti non sanno neanche che questo è il modo in cui l’AI funziona».

Jimson Weed white flower no.1, 1936, di Georgia O’keeffe

Una “galassia” in stile o’keeffe, Francesco Muzzi e Midjourney.

Il “riciclaggio” dei dati

Andy Baio, che scrive di AI e tecnologia sul blog waxy.org, definisce questa pratica “riciclaggio di dati”. Il metodo è lo stesso utilizzato per lo sviluppo di software di riconoscimento facciale come MegaFace, basato su una banca dati compilata dai ricercatori della Washington University con foto recuperate da Flickr. «I ricercatori hanno preso i dati e li hanno riciclati per renderli utilizzabili a fini commerciali», nota Baio. Ora queste informazioni, tra cui milioni di foto personali, sono nelle mani di società come Clearview AI, che vende i suoi servizi di cyber-sorveglianza all’esercito americano e a diverse forze dell’ordine in giro per il mondo. Non è un caso che il dibattito sul copyright di queste banche dati abbia già cominciato a spostarsi nelle aule dei tribunali. Microsoft, GitHub e OpenAI sono state colpite da una class action che le accusa di aver consentito a Copilot, AI che genera programmi, di utilizzare frammenti di codici scritti da altri e protetti da copyright. Midjourney, DeviantArt e Stability AI sono state citate in giudizio per avere violato i diritti di migliaia di artisti addestrando i loro software su immagini raccolte dal web

Chrysanthemums, 1878 -1883, di Claude Monet

“Stafilococco aureo” in stile Monet, Francesco Muzzi e Midjourney.

Da Google a Cambridge Analytica

C’è chi sostiene che questo utilizzo sia simile a quello fatto in passato da Google quando ha copiato milioni di libri per creare un motore di ricerca letterario. Un uso contestato dagli scrittori, ma giudicato lecito da una sentenza americana del 2015. Altri invece ritengono sia vero l’esatto opposto. E puntano ai provvedimenti più recenti dell’antitrust americana, che ha più volte ordinato la distruzione di algoritmi basati su dati raccolti all’insaputa dei loro titolari. Capostipite di questo orientamento è stato il caso Cambridge Analytica, società di consulenza condannata per aver utilizzato informazioni raccolte illecitamente attraverso Facebook al fine di creare campagne politiche. Nel dubbio, abbiamo chiesto un parere al diretto interessato, domandando a ChatGpt se si ritiene colpevole di violare il diritto d’autore. «In quanto sistema linguistico di AI non provo sentimenti personali, compreso il senso di colpa», è stata la sua gelida risposta. Alla quale aggiunge: «I modelli su cui sono stato addestrato includono una vasta gamma di scritti, compresi alcuni che potrebbero essere protetti da copyright. È responsabilità di Open AI [la società proprietaria del software, ndr] garantire che l’uso di questi dati sia conforme alle leggi sul copyright. Open AI ha adottato misure per ridurre al minimo il rischio di violazione, ma non può garantire che tutti i casi siano stati evitati. In ogni caso, io sono uno strumento creato per assistere e migliorare la comunicazione umana ed è responsabilità dei miei utenti garantire che l’uso dei risultati da me prodotti siano conformi a tutte le leggi applicabili, comprese quelle sul copyright». Una interpretazione difensiva della propria missione degna di un “azzeccagarbugli” in carne e ossa. Anche gli avvocati sono avvisati.